【ComfyUI插件】ComfyUI_Custom_Nodes_AlekPet插件(三)

前言:

本插件是由 AlekPet 开发的插件,旨在为 ComfyUI 提供多种实用功能,特别是在提示词翻译、绘画、颜色校正和动作设置等方面。新版本增加了基于ChatGLM-4 语言模型进行语言翻译。

__ComfyUI_Custom_Nodes_AlekPet插件(一): __https://articles.zsxq.com/AlekPet/1.html

__ComfyUI_Custom_Nodes_AlekPet插件(二): __https://articles.zsxq.com/AlekPet/2.html

目录

先行:安装方法

一、ChatGLM-4 Translate Text Node节点

二、ChatGLM-4 Translate CLIP Text Encode Node节点

三、ChatGLM-4 Instruct Node节点

四、ChatGLM-4 Instruct Media Node节点

安装方法

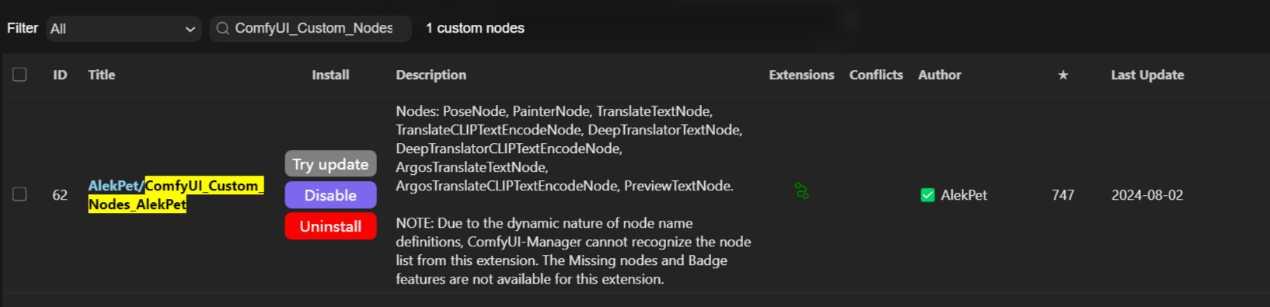

1、在manager里搜索ComfyUI_Custom_Nodes_AlekPet,然后点击安装即可

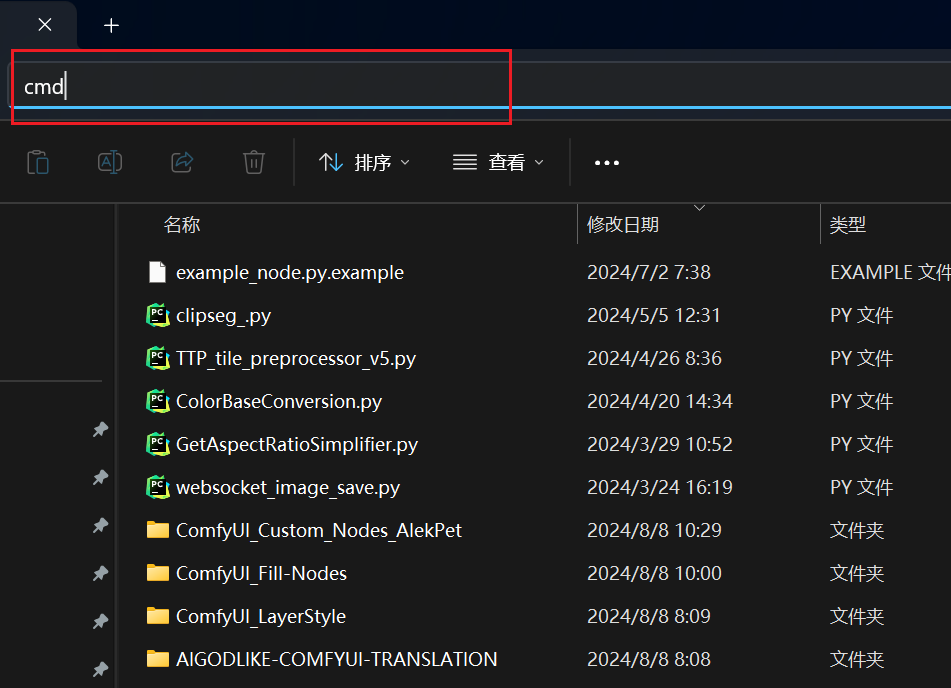

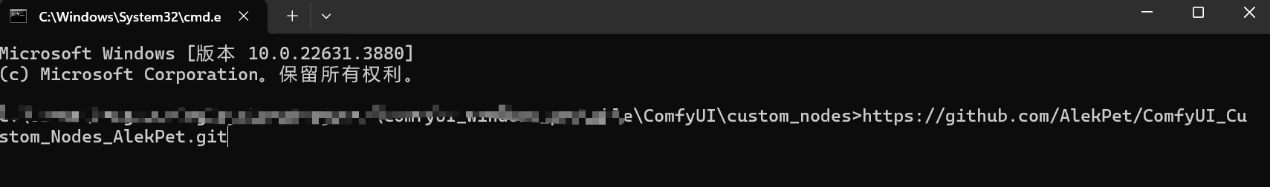

2、在custom_nodes目录下调用cmd, 然后输入git clone https://github.com/AlekPet/ComfyUI_Custom_Nodes_AlekPet.git ,回车后即可完成安装

项目地址:https://github.com/AlekPet/ComfyUI_Custom_Nodes_AlekPet.git

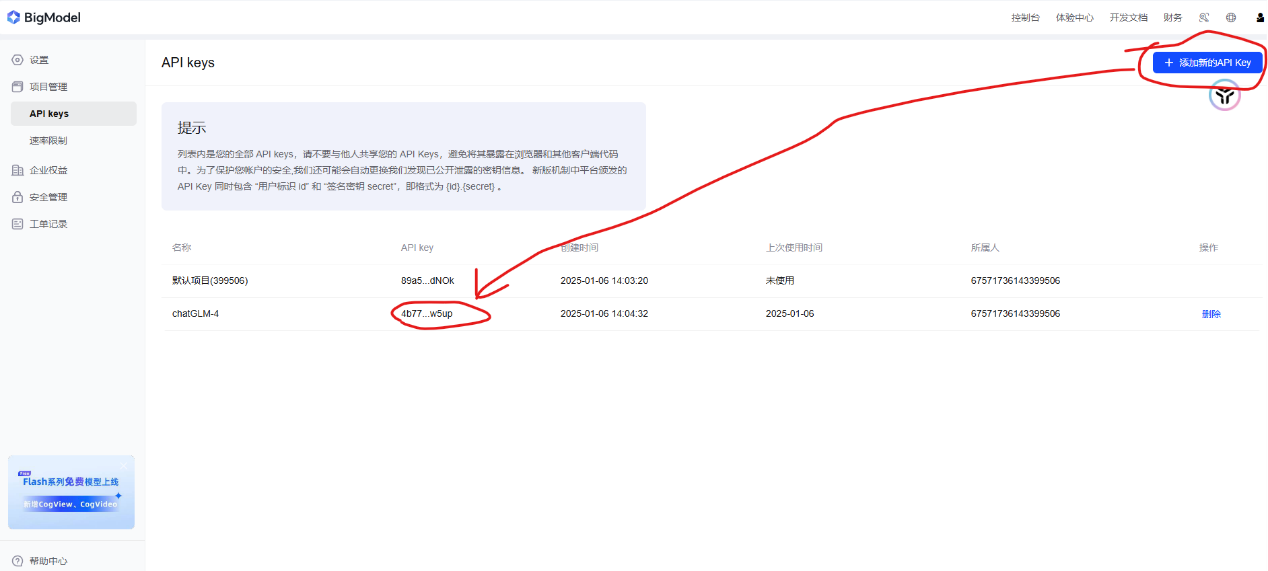

使用ChatGLM-4 Translate进行翻译还需要api keys才能翻译

1、首先去https://bigmodel.cn/进行注册,选择GLM-4-Flash,跳转到注册界面的时候,该注册注册。

点击接口文档

查看您的API Key

添加新的API key,自定义名称。

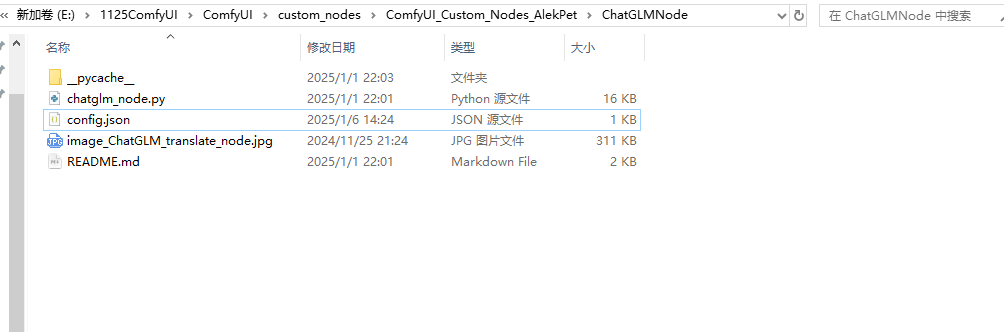

2、找到custom_nodes\ComfyUI_Custom_Nodes_AlekPet\ChatGLMNode文件夹,编辑其中的config.json文件,然后复制到"ZHUPUAI_API_KEY"中。

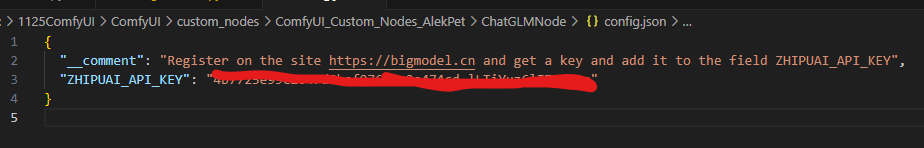

一、ChatGLM-4 Translate Text Node节点

节点功能:使用 ChatGLM-4 对输入的文本进行翻译,将其从源语言(from_translate)翻译成目标语言(to_translate)。

参数:

from_translate:源语言,用于指定输入文本的语言。

to_translate:目标语言,指定翻译后的文本语言。

model:使用的 ChatGLM-4 模型代码,选择不同的 ChatGLM-4 变体来处理翻译任务。该模式中只有glm-4-flash是免费的。

max_tokens:翻译时生成的最大 token 数。控制模型的输出长度。

temperature:采样温度,控制生成内容的随机性。数值越高,生成的内容越随机。

top_p:另一种控制随机性的方法,使用累积概率。

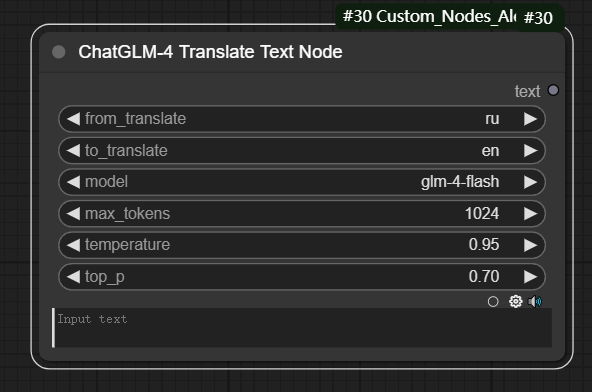

其中__max_tokens__是可以控制输出字数的。如下,当__max_tokens__设置为5时。提示词就没有翻译完。

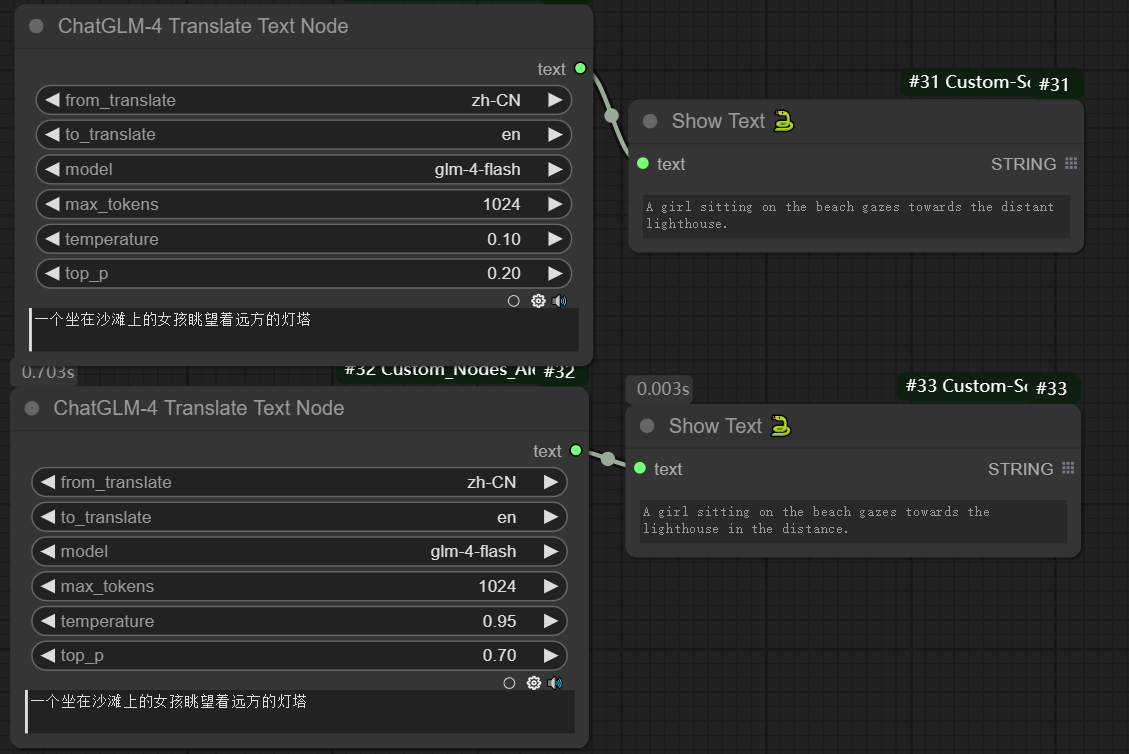

当把__temperature__或者__top_p__调大时,它会控制提示词翻译的随机变化程度,如下,调大后提示词的生成发生了变化。

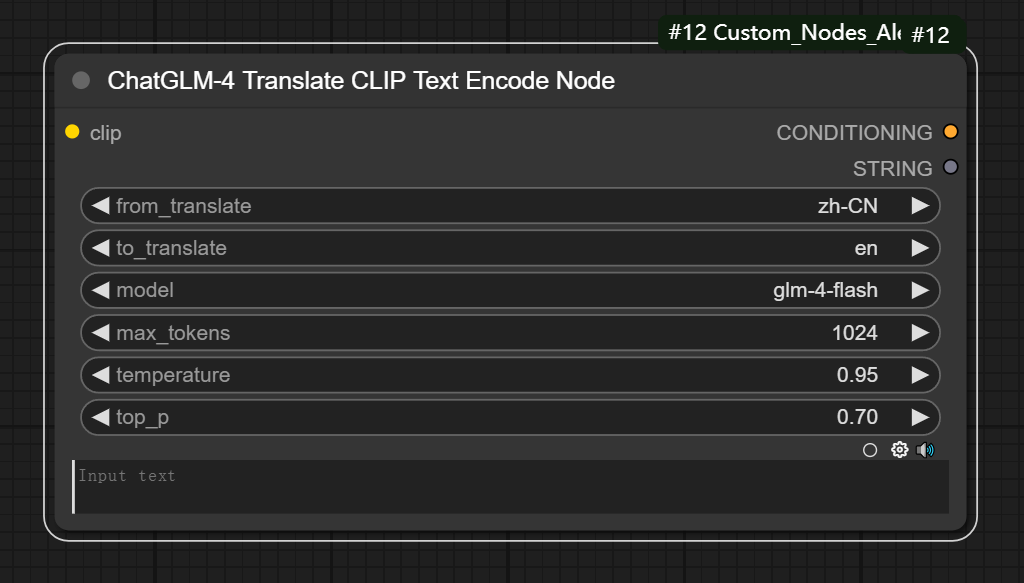

二、ChatGLM-4 Translate CLIP Text Encode Node节点

节点功能:该节点是一个结合了 ChatGLM-4 语言模型和 CLIP 模型的节点,可以使用 ChatGLM-4 对输入的文本进行翻译,将其从源语言(from_translate)翻译成目标语言(to_translate)。

参数:

from_translate:源语言,用于指定输入文本的语言。

to_translate:目标语言,指定翻译后的文本语言。

model:使用的 ChatGLM-4 模型代码,选择不同的 ChatGLM-4 变体来处理翻译任务。该模式中只有glm-4-flash是免费的。

max_tokens:翻译时生成的最大 token 数。控制模型的输出长度。

temperature:采样温度,控制生成内容的随机性。数值越高,生成的内容越随机。

top_p:另一种控制随机性的方法,使用累积概率。

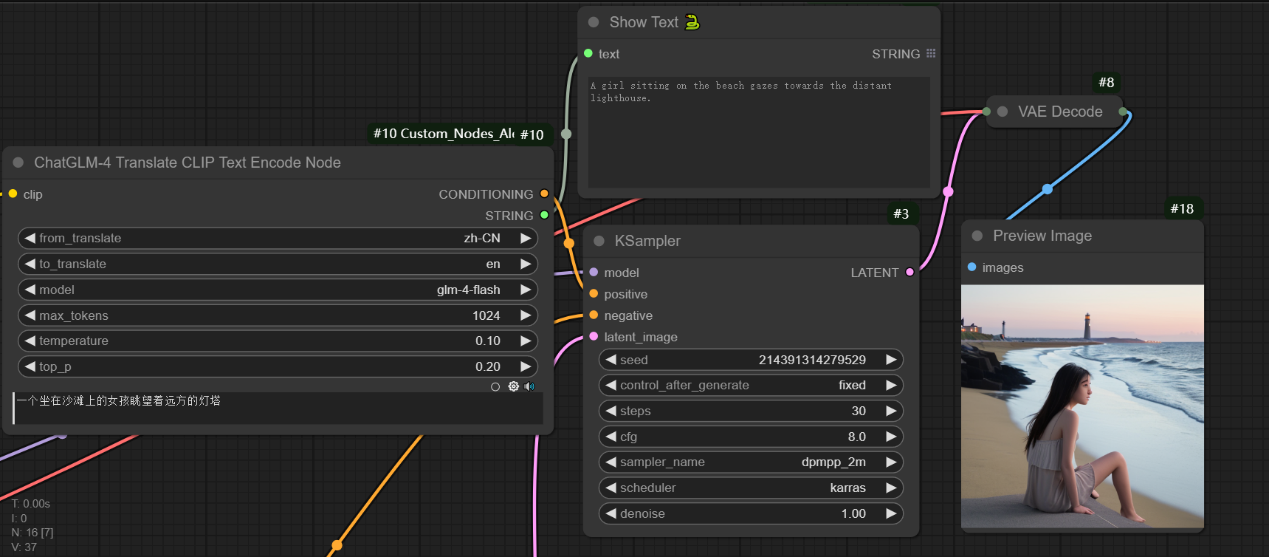

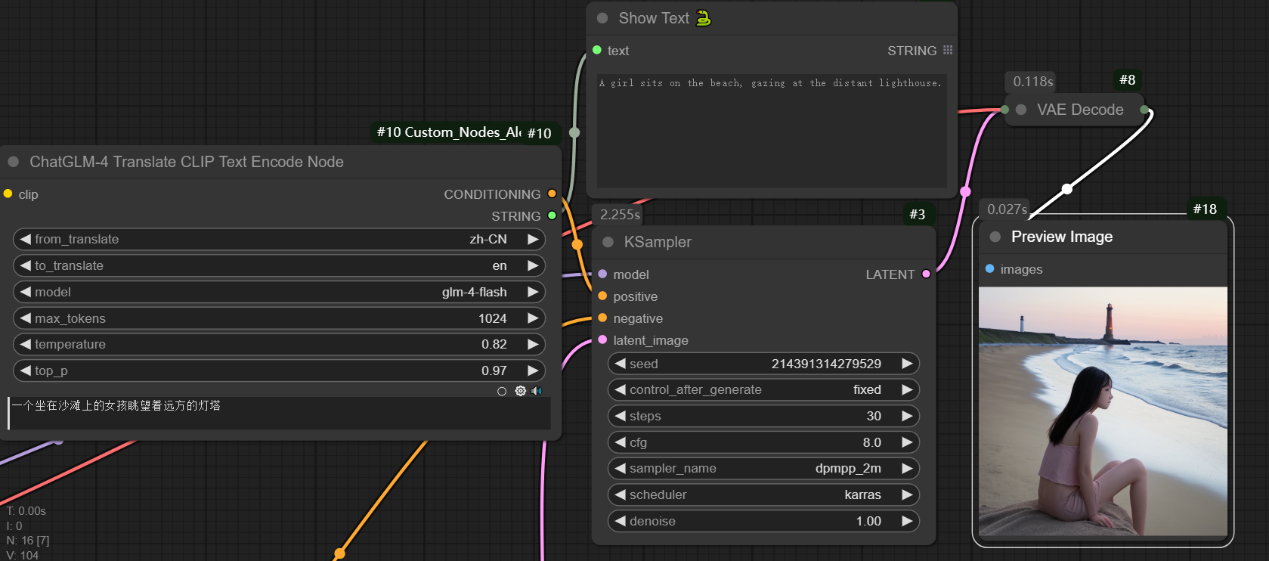

当把__temperature__或者__top_p__调大时,它会控制提示词翻译的变化,即使在KSampler中种子设为固定,生成图会有变化。因为相当于修改了提示词,但不会变化很大,句意并没有变化。

可以看到,把__temperature__或者__top_p__调大后,提示词的生成发生了变化,seed为fixed,图片有细微变化。

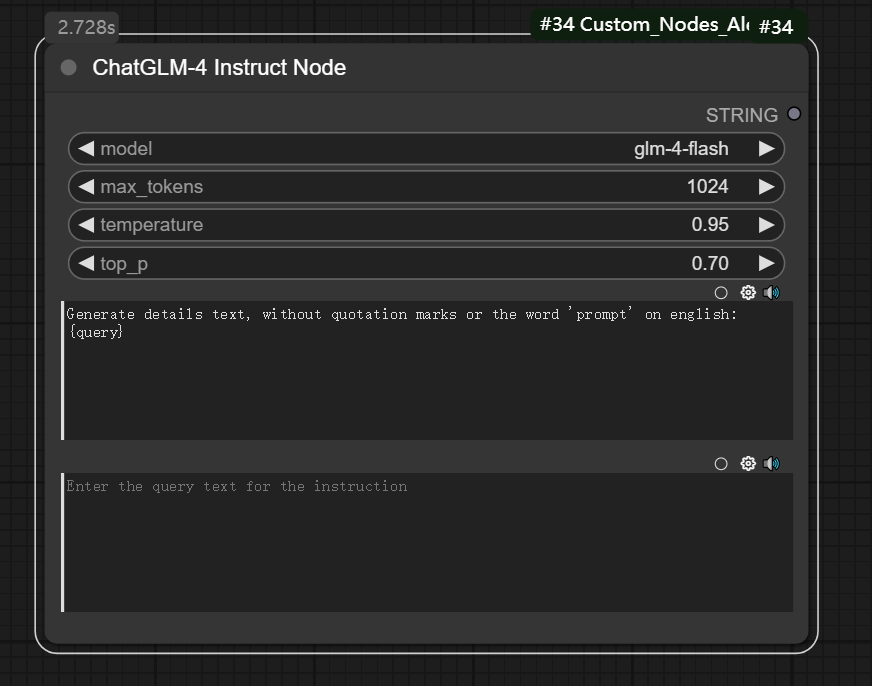

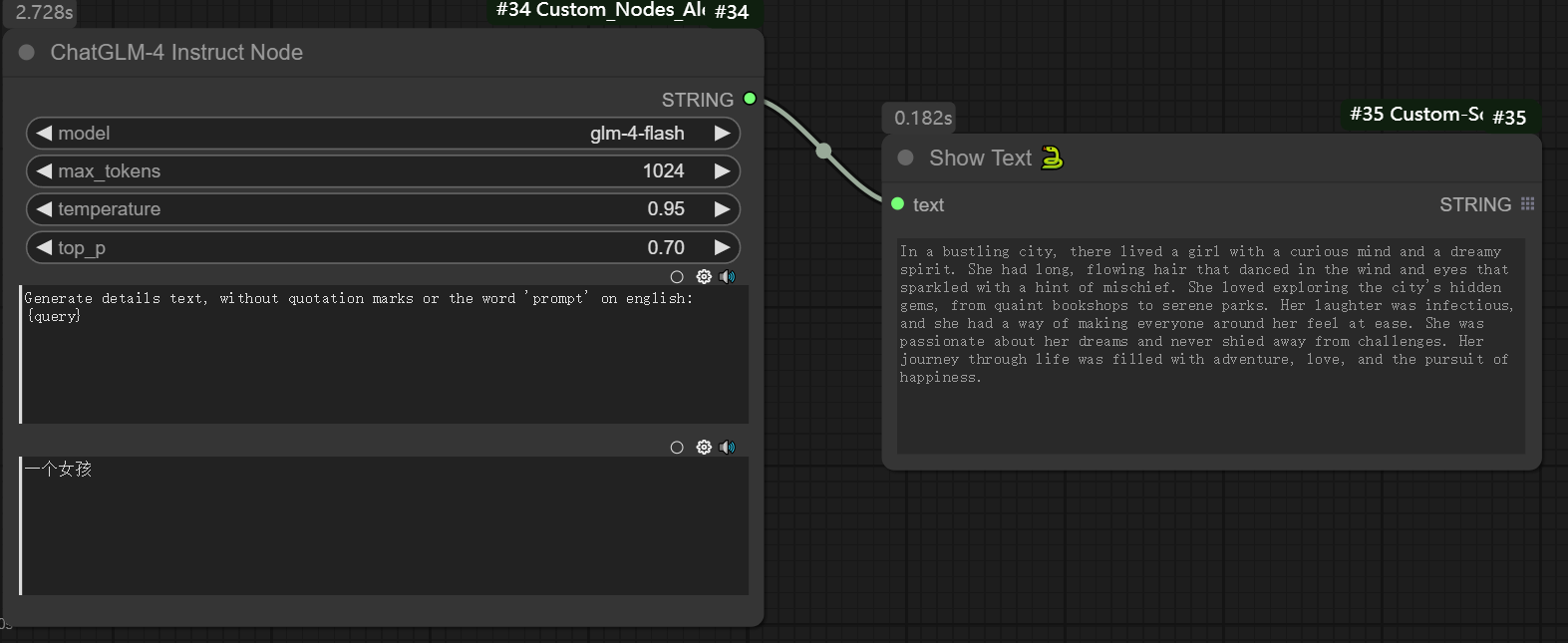

三、ChatGLM-4 Instruct Node节点

节点功能:该节点是一个基于 ChatGLM-4 模型的指令节点,允许用户向 ChatGLM-4 提供自定义指令并生成文本输出。该节点能够根据给定的指令和查询生成高质量的文本回答或补全,适用于多种自然语言处理任务,例如文本生成,问答系统,文本补全,代码生成或解释。(使用起来相当于chatgpt)

__

__

__

参数:__

from_translate:源语言,用于指定输入文本的语言。

to_translate:目标语言,指定翻译后的文本语言。

model:使用的 ChatGLM-4 模型代码,选择不同的 ChatGLM-4 变体来处理翻译任务。该模式中只有glm-4-flash是免费的。

max_tokens:翻译时生成的最大 token 数。控制模型的输出长度。

temperature:采样温度,控制生成内容的随机性。数值越高,生成的内容越随机。

top_p:另一种控制随机性的方法,使用累积概率。

如下图,在文本框中只输入了简短的一个词,然后生成了一大段话。

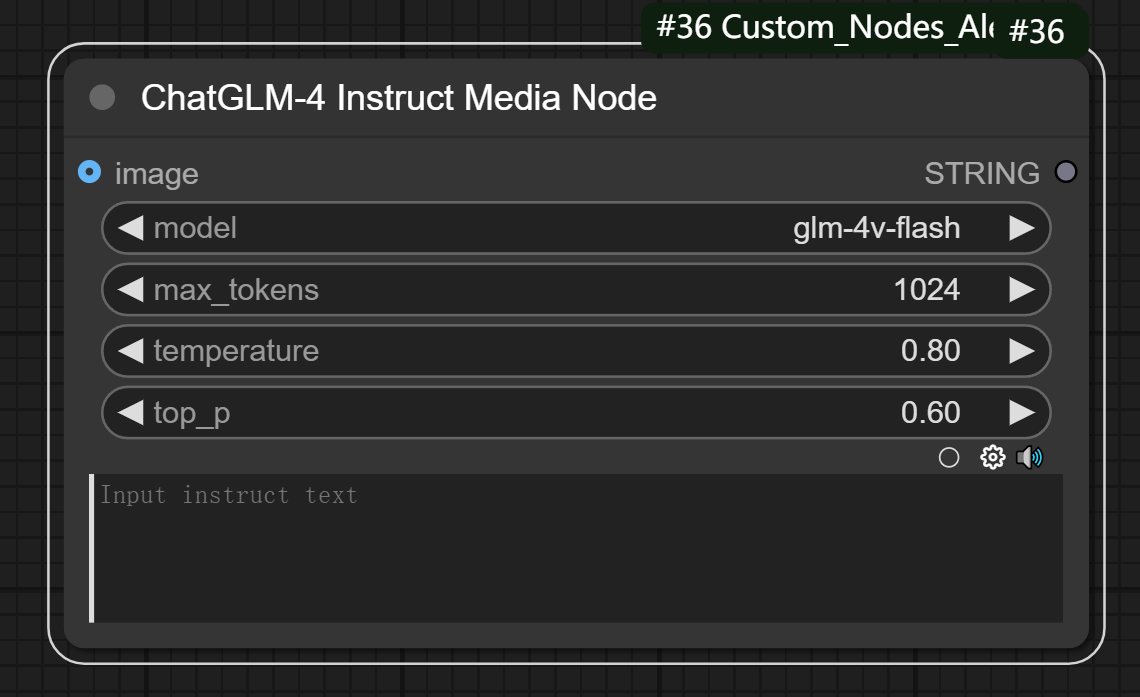

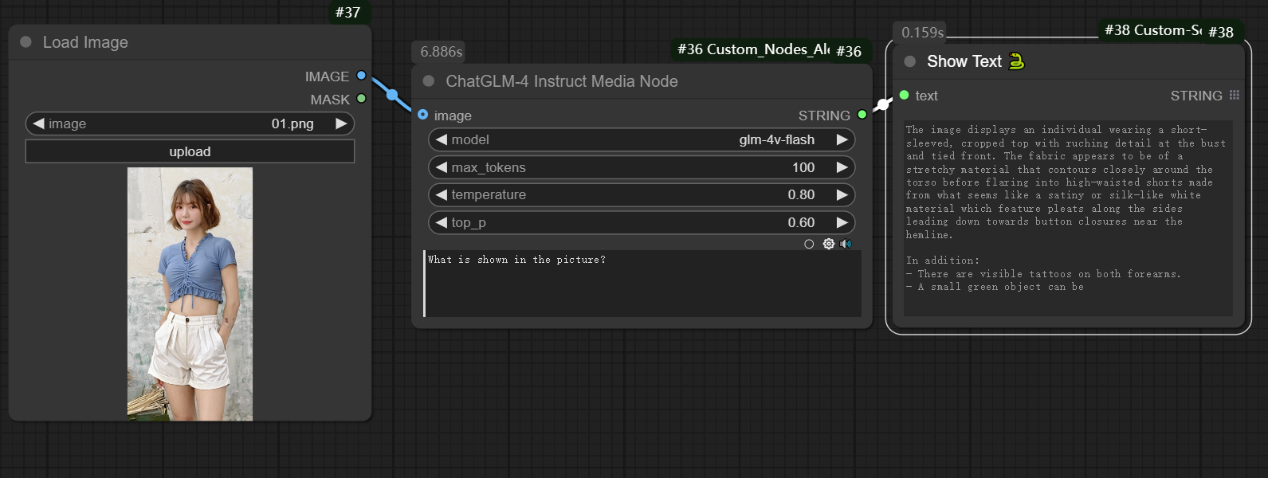

四、ChatGLM-4 Instruct Media Node节点

节点功能:该节点是一个多模态推理节点,基于 ChatGLM-4V 系列模型,支持图像和文本联合输入。该节点允许用户输入图像或视频(当前版本仅支持图像),并提供文本指令以实现视觉问答(VQA)、图像描述生成等任务。

__

__

参数:

model:使用的 ChatGLM-4 模型代码,选择不同的 ChatGLM-4 变体来处理翻译任务。该模式中只有glm-4-flash是免费的。

max_tokens:翻译时生成的最大 token 数。控制模型的输出长度。

temperature:采样温度,控制生成内容的随机性。数值越高,生成的内容越随机。

top_p:另一种控制随机性的方法,使用累积概率。

它可以按照输入的文本框问题输出对应的图片描述。如果要生成和问题更加对应的描述,__temperature__和__top_p__最好调小一点。如果描述要更加发散性,就调大一点。

__ComfyUI_Custom_Nodes_AlekPet插件(一): __https://articles.zsxq.com/AlekPet/1.html

__ComfyUI_Custom_Nodes_AlekPet插件(二): __https://articles.zsxq.com/AlekPet/2.html